部分的に崩壊した坑道に閉じ込められた作業員を捜索するロボットは、危険な地形を移動しながら現場の地図を迅速に作成し、その現場内の位置を特定する必要があります。

研究者らは最近、ロボットに組み込まれたカメラからの画像のみを使用してこの複雑なタスクを実行するための強力な機械学習モデルの構築を開始しましたが、最高のモデルであっても一度に数枚の画像しか処理できません。一秒一秒を争う現実の災害では、捜索救助ロボットはその任務を完了するために広いエリアを迅速に移動し、数千枚の画像を処理する必要があります。

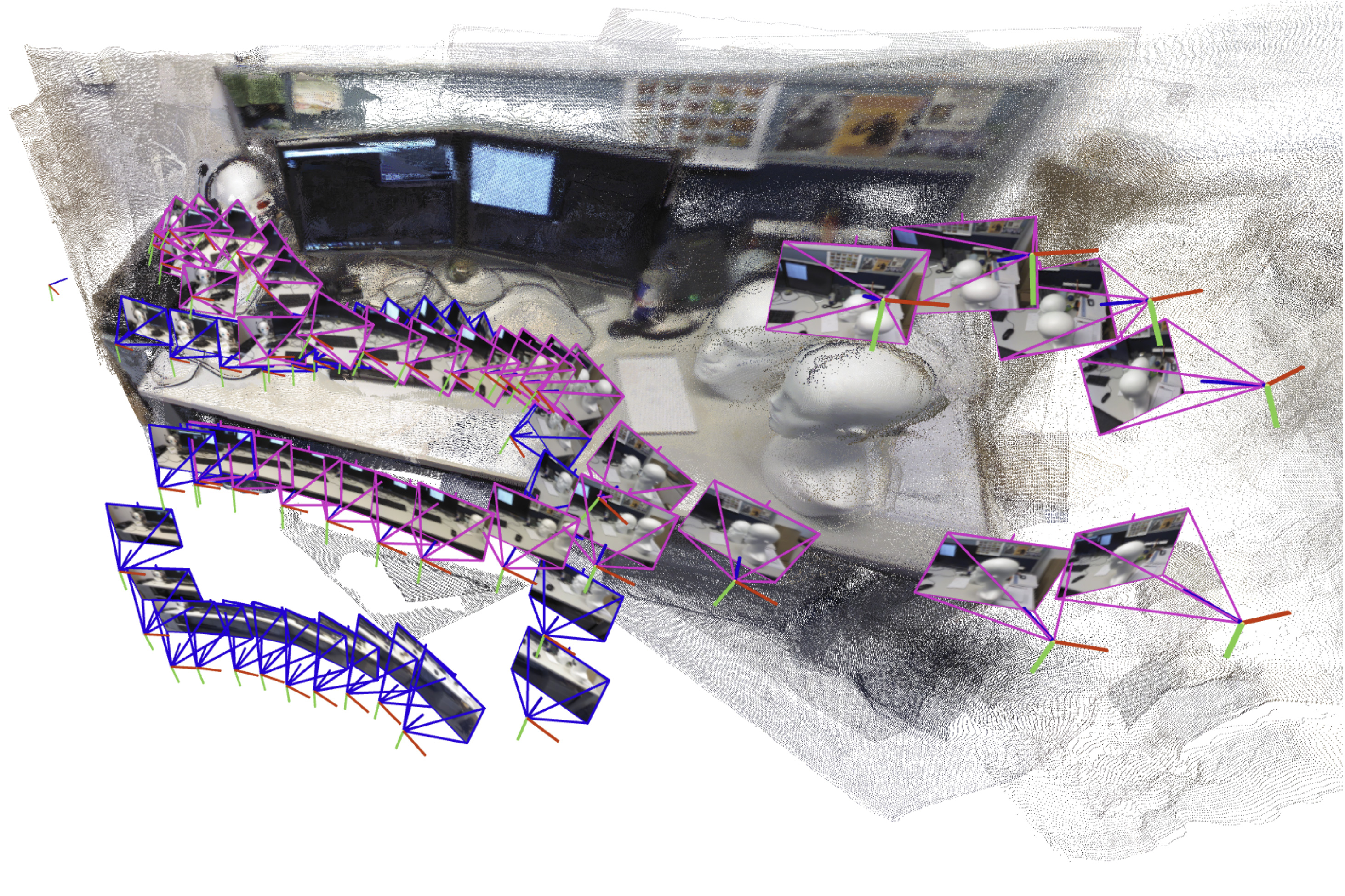

この問題を克服するために、MIT の研究者は、現在の人工知能ビジョン モデルと古典的なコンピューター ビジョンの両方からアイデアを引き出し、任意の数の画像を処理できる新しいシステムを開発しました。彼らのシステムは、混雑したオフィスの廊下などの複雑なシーンの 3D マップを数秒で正確に生成します。

AI 駆動のシステムは、シーンの小さなサブマップを徐々に作成して位置合わせし、リアルタイムでロボットの位置を推定しながら、それらをつなぎ合わせて完全な 3D マップを構築します。

他の多くのアプローチとは異なり、彼らの技術は、調整されたカメラや複雑なシステム実装を指示する専門家を必要としません。彼らのアプローチのシンプルな性質と 3D 再構成の速度と品質により、現実世界のアプリケーションのスケールアップが容易になります。

この方法は、捜索救助ロボットの移動を支援するだけでなく、VR ヘッドセットなどのウェアラブル デバイス用の拡張現実アプリケーションを作成したり、産業用ロボットが倉庫内で商品を迅速に見つけて移動できるようにするために使用できます。

「ロボットがますます複雑なタスクを実行するには、周囲の世界のより複雑な地図表現が必要です。しかし同時に、私たちはこれらの地図を実際に適用することを困難にしたくありません。私たちは、特別な設定を必要とせずに機能するツールを使用して、数秒で正確な 3 次元再構成を作成できることを示しました」と、この研究を卒業した MIT のドミニク・マッジオ氏は述べています。

この論文には、博士研究員の Hyungtae Lim 氏と、MIT 航空宇宙学部 (AeroAstro) の准教授、情報意思決定システム研究所 (LIDS) の主任研究員、MIT SPARK 研究所の所長である上級著者の Luca Carlon 氏がこの論文に参加しています。この研究は、神経情報処理システムに関する会議で発表される予定です。

ソリューションマッピング

研究者たちは長年にわたり、同時位置特定とマッピング (SLAM) と呼ばれるロボットナビゲーションの重要なコンポーネントに取り組んできました。 SLAM では、ロボットは空間内で自身の位置を調整しながら、環境のマップを再作成します。

このタスクの従来の最適化方法は、困難なシーンでは失敗する傾向があり、ロボットの内蔵カメラの事前キャリブレーションが必要です。これらの落とし穴を回避するために、研究者は機械学習モデルをトレーニングして、データからこのタスクを学習します。

実装は簡単ですが、最高のモデルでも一度に処理できるカメラ画像は約 60 枚までであり、数千枚の画像を処理しながらロボットがさまざまな環境を素早く移動する必要があるアプリケーションには使用できません。

この問題を解決するために、MIT の研究者は、マップ全体ではなくシーンの小さなサブマップを生成するシステムを設計しました。彼らの方法では、これらのサブマップを 1 つの全体的な 3D 再構成に「接着」します。このモデルはまだ一度に数枚の画像しか処理しませんが、システムは小さなサブマップをつなぎ合わせることで、大規模なシーンをはるかに高速に再作成できます。

「非常に単純な解決策のように思えましたが、最初に試したとき、それほどうまく機能しないことに驚きました」とマッジョ氏は言います。

説明を求めて、彼は 1980 年代と 1990 年代のコンピューター ビジョンの研究を詳しく調べました。この分析を通じて、Maggio 氏は、機械学習モデルが画像を処理する方法のエラーにより、サブマップの位置合わせがより複雑な問題になっていることに気づきました。

従来の方法では、位置が揃うまで回転と移動を適用してサブマップを位置合わせします。しかし、これらの新しいモデルはサブマップに曖昧さをもたらし、位置合わせを困難にする可能性があります。たとえば、部屋の片側の 3D サブマップには、わずかに曲がったり伸びたりした壁が含まれる場合があります。これらの歪んだサブマップを単に回転および移動してまっすぐにするだけでは機能しません。

「すべてのサブマップが相互に適切に位置合わせできるように、すべてのサブマップが一貫してワープされていることを確認する必要があります」と Carlon 氏は説明します。

より柔軟なアプローチ

研究者らは、古典的なコンピューター ビジョンからアイデアを借りて、これらのサブマップのすべての歪みを表現できる、より柔軟な数学的手法を開発しました。このより柔軟な方法では、各サブマップに数学的変換を適用することで、曖昧さに対処する方法でサブマップを位置合わせできます。

入力画像に基づいて、システムはシーンの 3D 再構成とカメラ位置の推定を出力し、ロボットはそれを使用して空間内での位置決めを行います。

「ドミニクが学習ベースのアプローチと従来の最適化手法という 2 つの世界を橋渡しする直観を持っていたら、実装は非常に簡単でした」とカーロン氏は言います。 「これほど効率的でシンプルなものの発明は、多くの用途に応用できる可能性を秘めています。

彼らのシステムは、特別なカメラや追加のデータ処理ツールを必要とせず、他の方法よりも再構成エラーが少なく、高速に動作しました。研究者らは、携帯電話で撮影した短いビデオのみを使用して、MIT 礼拝堂の内部などの複雑なシーンのほぼリアルタイムの 3D 再構成を作成しました。

これらの 3D 再構成の平均誤差は 5 センチメートル未満でした。

研究者らは将来的に、特に複雑なシーンでの手法の信頼性を高め、困難な設定で実際のロボットに実装することに取り組みたいと考えている。

「従来のジオメトリについて知っておくと役に立ちます。モデル内で何が起こっているのかを深く理解すれば、より良い結果が得られ、物事の拡張性が大幅に高まります」と Carlon 氏は言います。

この研究は、米国国立科学財団、米国海軍研究局、および韓国国立研究財団によって部分的に支援されています。現在 Amazon Scholar として休暇中の Carlon は、Amazon に入社する前にこの研究を完了しました。