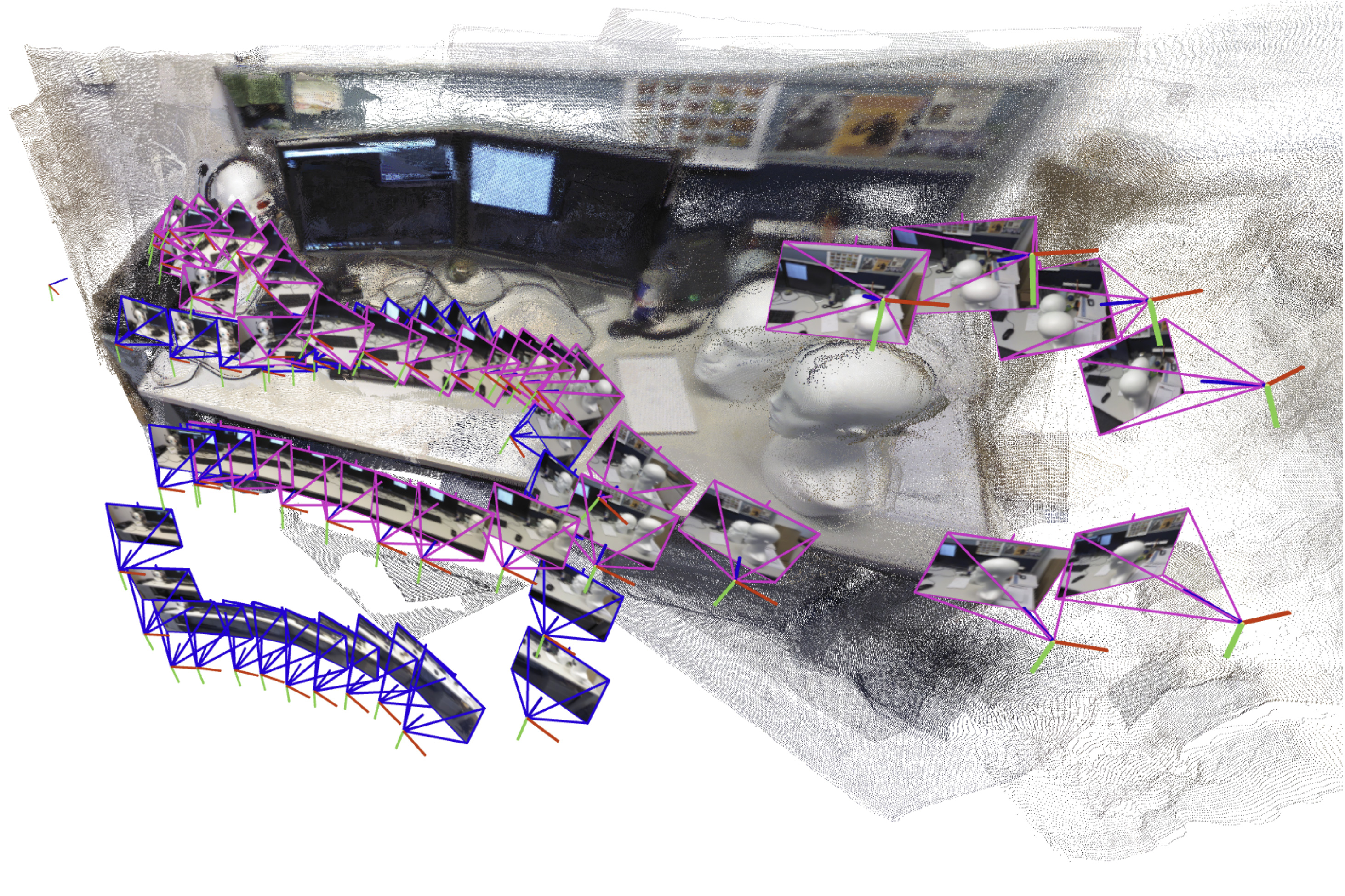

部分的に崩壊した坑道に閉じ込められた作業員を捜索するロボットは、危険な地形を移動しながら現場の地図を迅速に作成し、その現場内の位置を特定する必要があります。 研究者らは最近、ロボットに組み込まれたカメラからの画像のみを使用してこの複雑なタスクを実行するための強力な機械学習モデルの構築を開始しましたが、最高のモデルであっても一度に数枚の画像しか処理できません。一秒一秒を争う現実の災害では、捜索救助ロボットはその任務を完了するために広いエリアを迅速に移動し、数千枚の画像を処理する必要があります。 この問題を克服するために、MIT の研究者は、現在の人工知能ビジョン モデルと古典的なコンピューター ビジョンの両方からアイデアを引き出し、任意の数の画像を処理できる新しいシステムを開発しました。彼らのシステムは、混雑したオフィスの廊下などの複雑なシーンの 3D マップを数秒で正確に生成します。 AI 駆動のシステムは、シーンの小さなサブマップを徐々に作成して位置合わせし、リアルタイムでロボットの位置を推定しながら、それらをつなぎ合わせて完全な 3D マップを構築します。 他の多くのアプローチとは異なり、彼らの技術は、調整されたカメラや複雑なシステム実装を指示する専門家を必要としません。彼らのアプローチのシンプルな性質と 3D 再構成の速度と品質により、現実世界のアプリケーションのスケールアップが容易になります。 この方法は、捜索救助ロボットの移動を支援するだけでなく、VR ヘッドセットなどのウェアラブル デバイス用の拡張現実アプリケーションを作成したり、産業用ロボットが倉庫内で商品を迅速に見つけて移動できるようにするために使用できます。 「ロボットがますます複雑なタスクを実行するには、周囲の世界のより複雑な地図表現が必要です。しかし同時に、私たちはこれらの地図を実際に適用することを困難にしたくありません。私たちは、特別な設定を必要とせずに機能するツールを使用して、数秒で正確な 3 次元再構成を作成できることを示しました」と、この研究を卒業した MIT のドミニク・マッジオ氏は述べています。 この論文には、博士研究員の Hyungtae […]